中级技术内容

2026年 3月 5日

控制 NVIDIA CCCL 中的浮点确定性

如果使用相同的输入数据进行多次运行时能够产生完全一致的逐位计算结果,则该计算被称为确定性计算。这看似简单,但在实际中却难以实现,

2 MIN READ

2026年 3月 5日

NVIDIA Blackwell 刷新金融领域大模型推理 STAC-AI 历史纪录

大语言模型(LLM)通过精密分析大量非结构化数据,生成切实可行的交易见解,正在重塑金融交易格局。这些先进的 AI 系统能够处理金融新闻、

3 MIN READ

2026年 3月 3日

cuTile.jl 为 Julia 带来基于 NVIDIA CUDA Tile 的编程

NVIDIA CUDA Tile 是 NVIDIA CUDA 编程的一项重要新增功能,可自动访问 Tensor Core 和其他专用硬件。

2 MIN READ

2026年 3月 3日

如何利用编码智能体大幅降低游戏运行时的推理成本

NVIDIA ACE 是一套用于构建游戏 AI 智能体的技术。ACE 为游戏中角色的各个部分(从语音到智能,

2 MIN READ

2026年 2月 28日

开发者可用 5 款全新数字孪生产品构建 6G 网络

要实现 6G,电信行业必须应对一项根本性挑战:如何设计、训练并验证那些过于复杂而无法在现实世界中进行测试的 AI 原生网络。

2 MIN READ

2026年 2月 28日

使用 NVIDIA NeMo 构建电信自主网络推理模型

自主网络正迅速成为电信行业的重点任务之一。根据最新的 NVIDIA 电信行业 AI 现状报告,65% 的运营商表示 AI 正在推动网络自动化,

2 MIN READ

2026年 2月 25日

借助 NVIDIA Blackwell Ultra 提升 Softmax 的效率

LLM 上下文长度呈爆炸式增长,架构正朝着更复杂的注意力机制发展,例如多头潜在注意力(MLA)和分组查询注意力(GQA)。因此,

2 MIN READ

2026年 2月 23日

采用 NVFP4 低精度训练提升吞吐量,兼顾精度无损

随着 AI 模型和数据集规模的不断扩大,仅依赖更高精度的 BF16 训练已难以满足需求。训练吞吐量预期、内存限制以及成本上升等关键挑战,

3 MIN READ

2026年 2月 19日

借助 NVIDIA 多实例 GPU 和 NUMA 节点定位加速数据处理

NVIDIA Ampere、NVIDIA Hopper 和 NVIDIA Blackwell 系列中的 NVIDIA 旗舰数据中心 GPU…

3 MIN READ

2026年 2月 18日

NVIDIA 极致软硬件协同设计如何助力 Sarvam AI 主权模型实现惊人推理性能跃升

随着全球人工智能采用的加速,开发者面临日益严峻的挑战:如何提供符合现实世界延迟和成本要求的大语言模型(LLM)性能。

4 MIN READ

2026年 2月 18日

登顶 GPU 内核排行榜:借助 NVIDIA CUDA.compute 实现卓越性能

Python 在符合人体工程学的机器学习领域占据主导地位,但编写真正高效的 GPU 代码历来需要使用 C++ 编写自定义内核,

2 MIN READ

2026年 2月 18日

在 NVIDIA Run:ai 中利用 GPU 解锁大规模 Token 吞吐能力

随着 AI 工作负载的扩展,实现高吞吐量、高效资源利用和可预测的延迟变得愈发关键。 NVIDIA Run:ai 通过智能调度和动态 GPU…

4 MIN READ

2026年 2月 17日

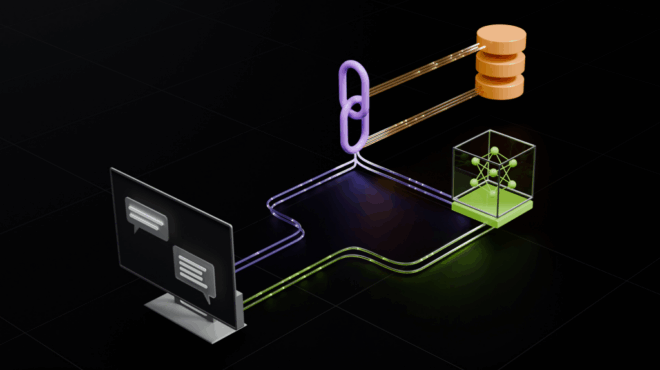

构建 AI 就绪型知识系统:掌握 5 种核心多模态 RAG 功能

企业数据本身具有高度复杂性:现实世界中的文档是多模态的,包含文本、表格、图表与图形、图像、扫描页面、表单以及嵌入式元数据。

3 MIN READ

2026年 2月 10日

使用加速计算在大型研究设施中实时引导科学实验

设计和建造独特科学研究设施的科学家与工程师同样面临诸多挑战,其中包括处理超出当前计算基础设施承载能力的海量数据速率,

3 MIN READ

2026年 2月 9日

借助 NVIDIA TensorRT LLM AutoDeploy 实现推理优化自动化

NVIDIA TensorRT LLM 使开发者能够为大语言模型 (LLM) 构建高性能推理引擎,但传统上部署新架构往往需要大量手动工作。

3 MIN READ

2026年 2月 5日

如何构建合规的 AI 模型蒸馏合成数据工作流

专用 AI 模型用于执行特定任务或解决特定问题。然而,如果您曾尝试对特定领域的模型进行微调或蒸馏,可能会遇到一些障碍,例如:

4 MIN READ