CUDA

2026年 3月 5日

控制 NVIDIA CCCL 中的浮点确定性

如果使用相同的输入数据进行多次运行时能够产生完全一致的逐位计算结果,则该计算被称为确定性计算。这看似简单,但在实际中却难以实现,

2 MIN READ

2026年 3月 5日

在 NVIDIA CUDA Tile 中调整 Flash Attention 以实现峰值性能

在本文中,我们将深入探讨现代 AI 中至关重要的工作负载之一:Flash Attention,您将了解: 环境要求:

9 MIN READ

2026年 3月 3日

cuTile.jl 为 Julia 带来基于 NVIDIA CUDA Tile 的编程

NVIDIA CUDA Tile 是 NVIDIA CUDA 编程的一项重要新增功能,可自动访问 Tensor Core 和其他专用硬件。

2 MIN READ

2026年 2月 19日

借助 NVIDIA 多实例 GPU 和 NUMA 节点定位加速数据处理

NVIDIA Ampere、NVIDIA Hopper 和 NVIDIA Blackwell 系列中的 NVIDIA 旗舰数据中心 GPU…

3 MIN READ

2026年 2月 18日

登顶 GPU 内核排行榜:借助 NVIDIA CUDA.compute 实现卓越性能

Python 在符合人体工程学的机器学习领域占据主导地位,但编写真正高效的 GPU 代码历来需要使用 C++ 编写自定义内核,

2 MIN READ

2026年 2月 10日

使用加速计算在大型研究设施中实时引导科学实验

设计和建造独特科学研究设施的科学家与工程师同样面临诸多挑战,其中包括处理超出当前计算基础设施承载能力的海量数据速率,

3 MIN READ

2026年 1月 30日

使用通用稀疏张量建立可扩展的稀疏生态系统

稀疏张量是向量、矩阵以及高维数组在包含大量零元素情况下的推广形式。由于其在存储、计算和功耗方面的高效性,稀疏张量在科学计算、

5 MIN READ

2026年 1月 30日

借助 CUDA Tile IR 后端推进 OpenAI Triton 的 GPU 编程

NVIDIA CUDA Tile 是基于 GPU 的编程模型,其设计目标是为 NVIDIA Tensor Cores 提供可移植性,

2 MIN READ

2026年 1月 21日

使用 Single Call API 简化 CUB

C++ 模板库 CUB 提供了高性能 GPU 基元算法,但其将内存估计与分配分离的传统“两阶段”API 可能带来使用上的不便。

2 MIN READ

2026年 1月 14日

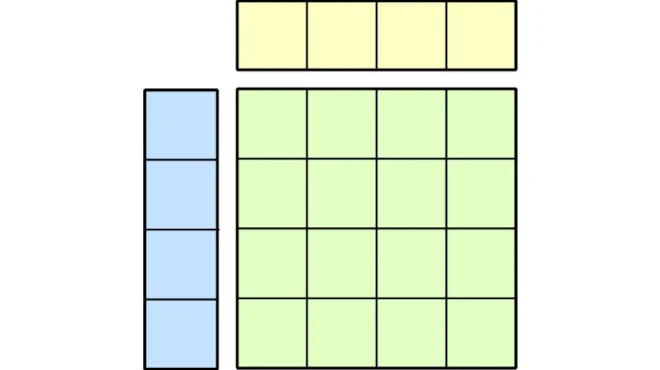

如何在 NVIDIA CUDA Tile 中编写高性能矩阵乘法

本博文是系列课程的一部分,旨在帮助开发者学习 NVIDIA CUDA Tile 编程,掌握构建高性能 GPU 内核的方法,

5 MIN READ

2026年 1月 5日

深度解析 NVIDIA Rubin 平台:六款新芯片打造AI超级计算机

AI 已进入工业阶段。 最初是用于执行离散 AI 模型训练和面向人类推理的系统,现已演变为全天候运行的 AI 工厂,持续将功率、

12 MIN READ

2025年 12月 17日

使用 NVIDIA cuDSS 解决大规模线性稀疏问题

随着芯片设计、制造和多物理场仿真复杂性的持续提升,在电子设计自动化(EDA)、

5 MIN READ

2025年 12月 16日

使用 NVIDIA CUDA MPS 无需修改代码即可提升 GPU 显存性能

NVIDIA CUDA 开发者可以利用多种工具和库来简化开发与部署,使用户能够专注于应用程序的“内容”和“方式”。 多进程服务 (MPS)…

5 MIN READ

2025年 12月 15日

减小 CUDA 二进制大小以在 PyPI 上分发 cuML

从 25.10 版本开始,现在可以直接从 PyPI 下载用于 pip 安装的 cuML wheels。

3 MIN READ

2025年 12月 10日

更高效的漏洞检测:Compute Sanitizer 编译时插桩如何增强内存安全性

CUDA C++ 是一种带有扩展功能的标准 C++,支持函数在 GPU 的多个并行线程上执行。它在推动广泛应用的同时,

3 MIN READ

2025年 12月 4日

专注于你的算法——让 NVIDIA CUDA Tile 来处理硬件细节

NVIDIA CUDA 13.1 推出 NVIDIA CUDA Tile,这是自 2006 年 NVIDIA CUDA 平台发明以来,

2 MIN READ