NVIDIA 数据中心深度学习产品性能

可复现的性能

通过 IT 领导者的战略指南了解如何降低每个 token 的成本,并最大化 AI 模型的价值。

查看以下方面的性能数据:

最新 NVIDIA 数据中心产品

NVIDIA Blackwell Ultra 为代理式 AI 提供高达 50 倍的性能提升和 35 倍的成本降低

NVIDIA Blackwell Ultra 专为加速新一代代理式 AI 而打造,可在大幅降低成本的同时提供突破性的推理性能。微软、CoreWeave 和 Oracle Cloud Infrastructure 等云提供商正在大规模部署 NVIDIA GB300 NVL72 系统,用于低延迟和长上下文用例,例如代理式编码和编码助手。

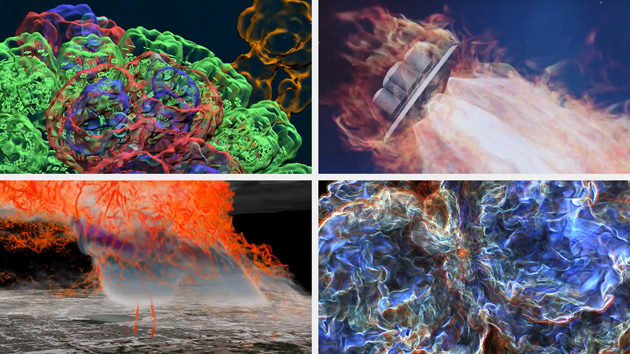

这是通过 NVIDIA Blackwell、NVLink™ 和 NVLink Switch 之间的深度联合设计实现横向扩展;通过 NVFP4 实现低精度精度;通过 NVIDIA Dynamo 和 TensorRT™ LLM 实现速度和灵活性,以及使用社区框架 SGLang、vLLM 等进行开发来实现的。

深度学习产品性能资源

NVIDIA 数据中心深度学习产品性能常见问题

NVIDIA 每百万 token 的推理成本在各代产品中有了显著改善:根据 Q1 2026 的 SemiAnalysis InferenceX 基准测试,NVIDIA Blackwell Ultra(GB300 NVL72)在低延迟 agentic 工作负载上,通过软硬件协同设计,实现了每 MW 吞吐量最高提升至 50 倍、每 token 成本最多降低了 35 倍。软件优化则带来持续收益——GB200 的 token 吞吐在三个月内提升了 4 倍,对应地每 token 成本也按比例下降。

在 2026 年 4 月发布的 MLPerf Inference v6.0 基准中,基于 NVIDIA Blackwell Ultra GPU(GB300 NVL72)的系统在最广泛的模型与场景组合上提供了极具竞争力的最高吞吐表现。对于 DeepSeek-R1 模型,GB300 NVL72 的吞吐量达到每秒 250 万个 token,相比六个月前 GB300 NVL72 首次提交的结果,token 吞吐提升最高可达 2.7 倍,而这一跃升主要来自 NVIDIA TensorRT™-LLM 软件更新所带来的优化。

NVIDIA Blackwell B200 在搭载最新 TensorRT-LLM 软件栈、运行 GPT-OSS-120B 模型时,每块 GPU 可实现最高约每秒 60,000 个 token 的吞吐量(截至 2026 年 4 月的 SemiAnalysis InferenceX 基准测试结果),相较使用 TensorRT-LLM 的 H200,吞吐量大约提升了 4 倍。如此水平的吞吐性能,使得 NVIDIA Blackwell B200 在同一模型上结合 TensorRT-LLM 时,可将每百万个 token 的成本压低至约 0.02 美元。

NVIDIA 的 TensorRT-LLM 和 Dynamo 软件栈在无需更换硬件的前提下,持续降低推理成本。根据截至 2026 年 4 月的 SemiAnalysis InferenceX 基准测试数据,NVIDIA Blackwell B200 在 GPT-OSS-120B 模型上的每百万 token 成本,从发布初期的 0.11 美元降至 0.02 美元,仅用两个月就实现了约 5 倍的改进,这一变化完全来自软件优化。每个新版本的 TensorRT-LLM 通常会通过算子/内核融合、量化改进以及调度优化等手段带来吞吐提升,从而进一步摊薄单位 token 的推理成本。

探索软件容器、模型、Jupyter Notebook 和文档。