NVIDIA Cloud Functions(NVCF)

NVIDIA Cloud Functions(NVCF)是一个统一的 API 层,用于在多个 Kubernetes 集群上运行和扩展推理、微调、批处理以及仿真等工作负载。它可以无缝集成到 NVIDIA Cloud Provider(NCP)以及各类独立软件供应商(ISV)环境中,并从底层基础设施继承安全的多租户隔离能力。

NVIDIA Cloud Function 的工作原理

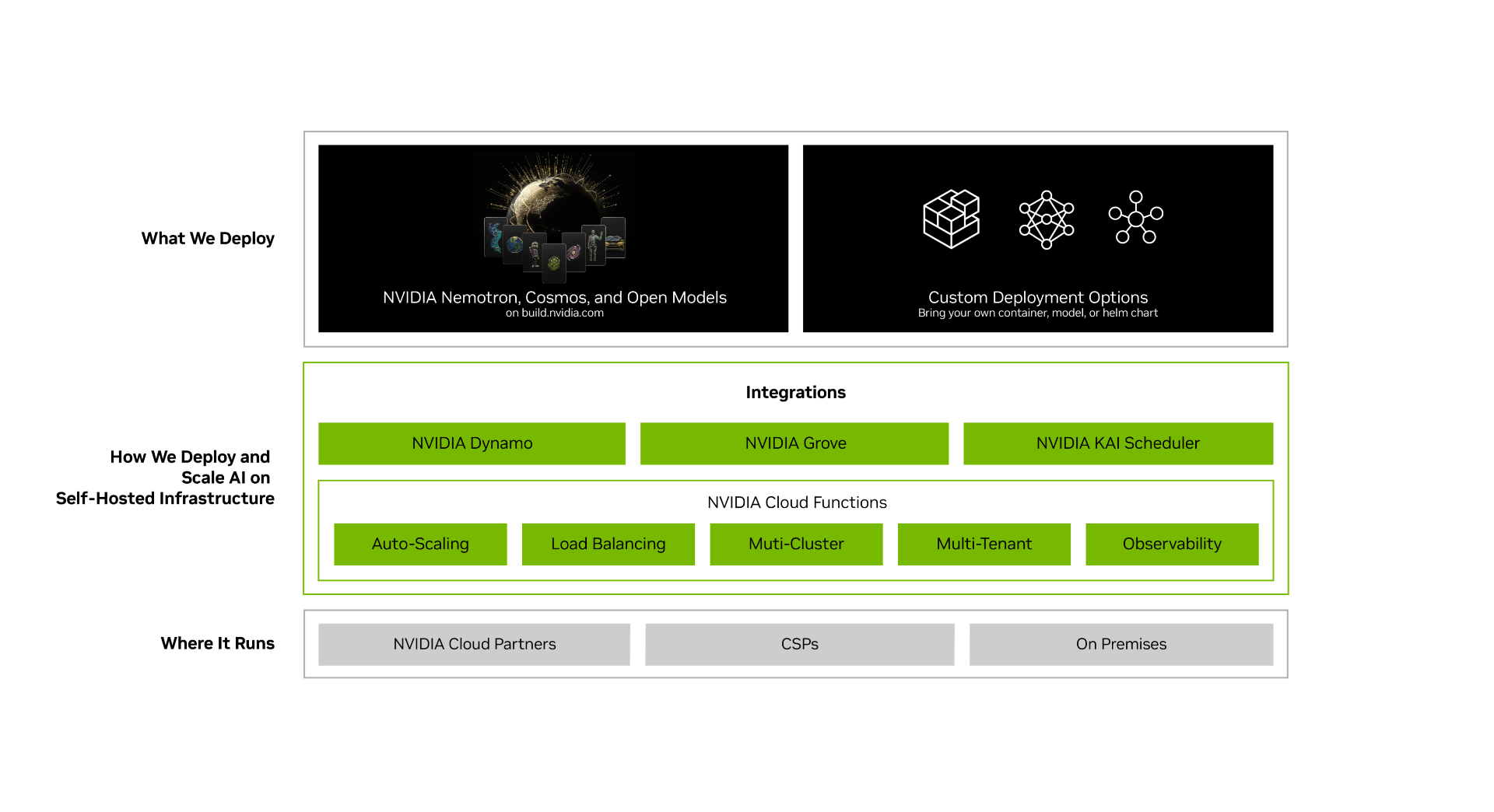

NVIDIA Cloud Functions(NVCF)让 AI 开发者可以轻松部署并扩展 agentic AI、physical AI 和仿真等工作负载,既支持使用 Nemotron™、Cosmos™ 等 NVIDIA 模型,也支持来自 build.nvidia.com 的部分开源模型,为团队提供按需选择最适合自身业务模型的灵活性。通过与 NVIDIA Dynamo、NVIDIA Grove 和 KAI Scheduler 集成,NVCF 实现自动伸缩、多租户能力和高 GPU 利用率,同时降低平台碎片化问题。它通过一个统一的分布式多节点推理 API 简化了复杂工作负载的扩展与运维,加快产品从开发到上线的周期。

NVIDIA Cloud Functions 主要特性

自动扩展到零

借助 NVCF,您可以在不活动期间将实例缩减为零,从而优化资源利用率并降低成本。冷启动时间不会产生额外成本,并且系统经过优化,可更大限度地减少这些成本。

BYO 可观测性

NVCF 提供了强大的可观测性功能。它允许您集成您首选的监控工具 (例如 Splunk) ,以全面了解您的 AI 工作负载。

广泛的工作负载支持

NVCF 提供灵活的部署选项,无论您是引入自己的容器、模型和 Helm 图表,还是在 build.nvidia.com 上使用 NVIDIA 的开放模型车队 (包括 Nemotron、Cosmos、GR00T、Clara™、Alpamayo、Apollo 和 Earth-2) ,均可轻松实现。您可以无缝创建和扩展针对特定 AI 工作负载定制的函数。

主权部署

NVCF 可部署在自托管基础设施 (包括 CSP 环境、NVIDIA 云合作伙伴 (NCP)) 或本地,使您能够将模型和数据保留在所需区域内,并满足主权要求。

开始使用 NVIDIA 云功能

NVIDIA Cloud Functions 生态系统

ISV 是 NVCF 生态系统的核心,基于 NVCF 的运行时功能 (例如自动扩展、负载平衡和可观察性) 构建 AI 应用。它们将平台和模型转变为面向客户的垂直解决方案,推动实际应用。

更多资源

AI 伦理

NVIDIA 认为,可信 AI 是一项共同的责任,我们制定了相关政策和实践,以支持在各种应用中开发 AI。根据我们的服务条款下载或使用此模型时,开发者应与其支持的模型团队合作,确保此模型满足相关行业和用例的要求,并解决不可预见的产品滥用问题。

有关此模型道德因素的更多详细信息,请参阅模型卡 可解释性、偏差、安全性和隐私子卡。请单击此处报告安全漏洞或 NVIDIA AI 问题。