NVIDIA NeMo Retriever

NVIDIA NeMo™ Retriever 是一个开源库,相比基于 CPU 的替代方案,能够以最高达 15 倍的速度对复杂文档进行摄取与结构化处理,为企业数据在 RAG 应用中的使用做好准备。

NVIDIA Nemotron™ 通过开源模型为 RAG 提供支持,在信息抽取、embedding 和 reranking 方面实现先进能力,支持安全、可扩展的检索,并由开放数据集和训练工具提供支持。

这些技术构成了 NVIDIA 的 RAG Blueprint——一个可定制的开放起点,用于构建与 AI 数据平台连接的生产级 RAG 应用。

Nemotron 在视觉文档检索的排行榜上表现出色,位居前列。

文档

借助可扩展的数据提取、高精度嵌入和重新排序,构建出色的信息检索工作流RAG Blueprint。

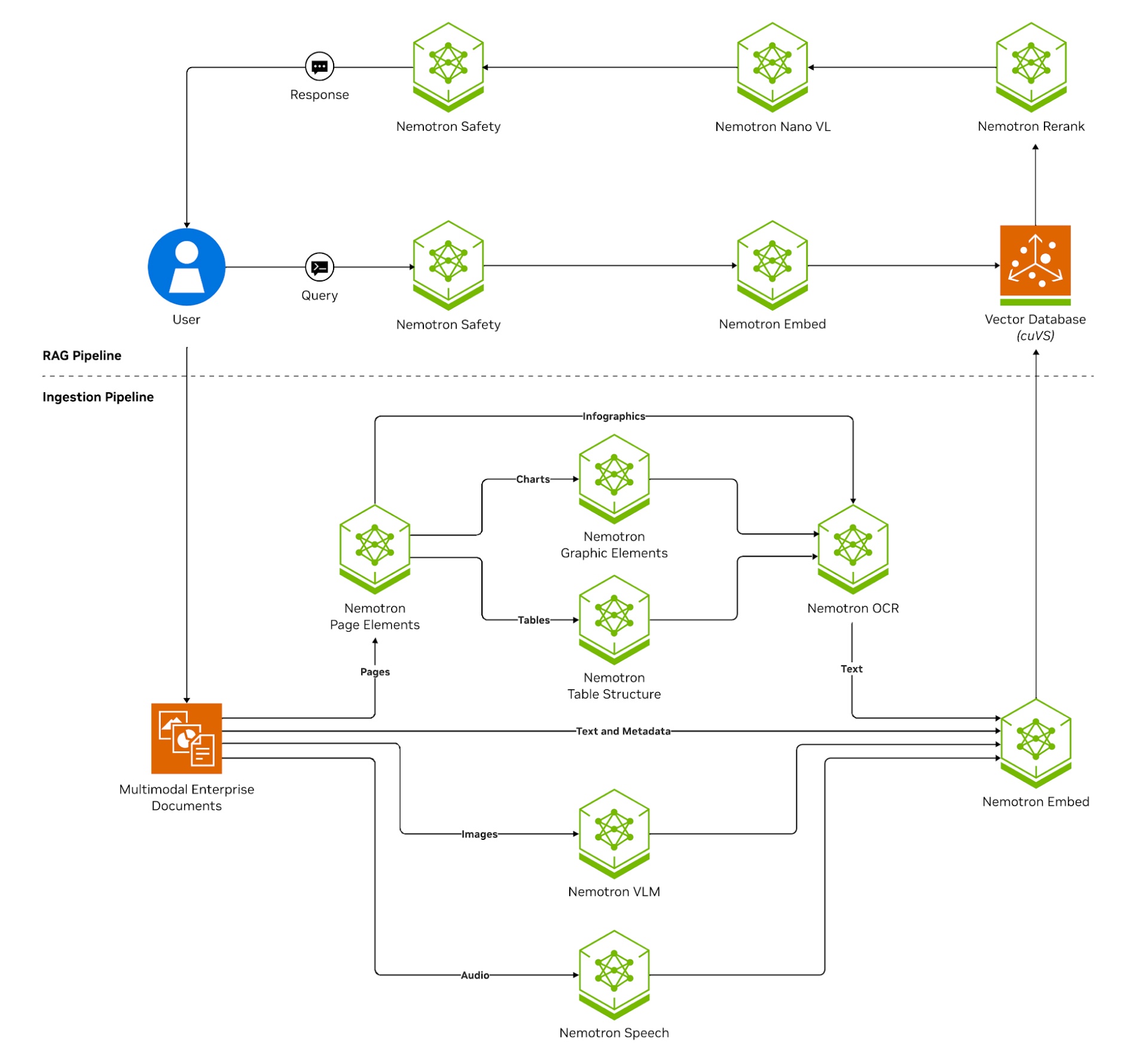

NVIDIA NeMo Retriever 的工作原理

使用模块化的 GPU 加速组件构建端到端数据提取和检索工作流。

摄取:从结构化和非结构化文档中提取文本、表格和图表,并对内容进行重复数据删除和分块。

嵌入:使用 Nemotron 嵌入模型存储在 NVIDIA cuVS 用于快速索引和搜索的加速向量数据库。

检索和重新排序:在查询时,执行向量相似性搜索,并使用 Nemotron 重排序模型提高精度。

生成:将最佳结果传递给 Nemotron LLM,以生成基于上下文的相关响应。

入门资源

详细了解如何使用 Nemotron 构建智能文档处理工作流。

出色的信息检索性能

Nemotron 能够以更低的成本和更高的准确性加速多模态文档提取和实时检索。它支持可靠的多语种跨语言检索,并优化了 AI 数据平台的存储、性能和适应性,从而实现高效的向量数据库扩展。

错误答案减少 50%

NeMo Retriever 多模态提取

关闭 NIM:开源替代方案:硬件:1xH100

启用 NIM:NeMo Retriever 提取微服务 ( nemoretriever-page-elements-v2、nemoretriever-table-structure-v1、nemoretriever-graphic-elements-v1、paddle-ocr) 。

嵌入吞吐量提高 3 倍

Nemotron 嵌入

关闭 NIM:开源替代方案:FP16。

启用 NIM:NeMo Retriever Llama 3.2 多语种嵌入微服务 (llama-3.2-nv-embedqa-1b-v2) ,FP8。

多模态数据提取吞吐量提高 15 倍

NeMo Retriever 提取

NIM Off:开源替代方案。

启用 NIM:NeMo Retriever 提取微服务 ( nv-yolox-structured-image-v1、nemoretriever-page-elements-v1、nemoretriever-graphic-elements-v1、nemoretriever-table-structure-v1、PaddleOCR、nv-llama3.2-embedqa-1b-v2) 。

数据存储效率提高 35 倍

Nemotron 嵌入

.svg)

如何开始使用 NVIDIA NeMo Retriever

使用合适的工具和技术构建和部署需要安全准确的信息检索的生成式 AI 应用,为各行各业的组织生成实时业务见解。

入门套件

开始构建信息检索工作流和生成式 AI 应用,通过访问 NVIDIA Blueprints、教程、Notebook、博客、论坛、参考代码、综合文档等。

评估和自定义 RAG 工作流

使用 NVIDIA NeMo 微服务针对类似于用户需求的数据和查询评估预训练的嵌入模型,以优化 RAG 性能。

NVIDIA NeMo Retriever 学习库

更多资源

伦理 AI

NVIDIA 的平台和应用框架使开发者能够构建各种 AI 应用。在选择或创建要部署的模型时,考虑潜在的算法偏差。与模型的开发者合作,确保模型符合相关行业和用例的要求;提供必要的说明和文档以了解错误率、置信区间和结果;并确保在符合预期条件和方式的情况下使用模型。