重塑计算格局的 AI 热潮将在 2026 年进一步加速扩展。随着模型能力与计算能力的突破持续推动发展,企业数据中心正逼近传统服务器和机架架构的极限,对功率预算、散热空间及设施布局带来了新的挑战。

NVIDIA MGX 模块化参考架构采用前瞻性设计,通过标准化构建模块显著缩短上市时间(TTM)。MGX 能够协助系统合作伙伴高效集成快速演进的技术,为现代 AI 数据中心提供灵活且节能的平台。

本文将探讨 MGX 模块化参考架构的下一次演进:专为新一代加速计算与网络平台设计的 6U(800 毫米)机箱配置,其中包括全新液冷版本的 NVIDIA RTX PRO 6000 Blackwell Server Edition GPU。

灵活、面向未来的设计,具备更强的可维护性

前瞻性兼容性和灵活性是 MGX 6U 平台的核心设计原则。该平台采用统一机箱设计,支持跨多代计算技术和多种工作负载配置。它不仅能够承载当前高性能的计算平台,还能提供面向未来的兼容能力,有效降低随时间推移对颠覆性重新设计的依赖。

合作伙伴可采用多种基于 MGX 的主机处理器模组(HPM)来设计这些系统,包括 x86 平台和新一代 NVIDIA Vera CPU。这有助于在单一服务器设计上实现标准化,同时满足多样化的 CPU 架构和工作负载需求。

最后,更大的机箱体积为维护提供了便捷的可访问路径。网卡、电源及其他可现场更换的单元等关键部件均易于触及。在管理机架级基础设施时,这有助于提升可维护性并降低运营成本。

液冷 NVIDIA RTX PRO 服务器实现可持续的高效计算

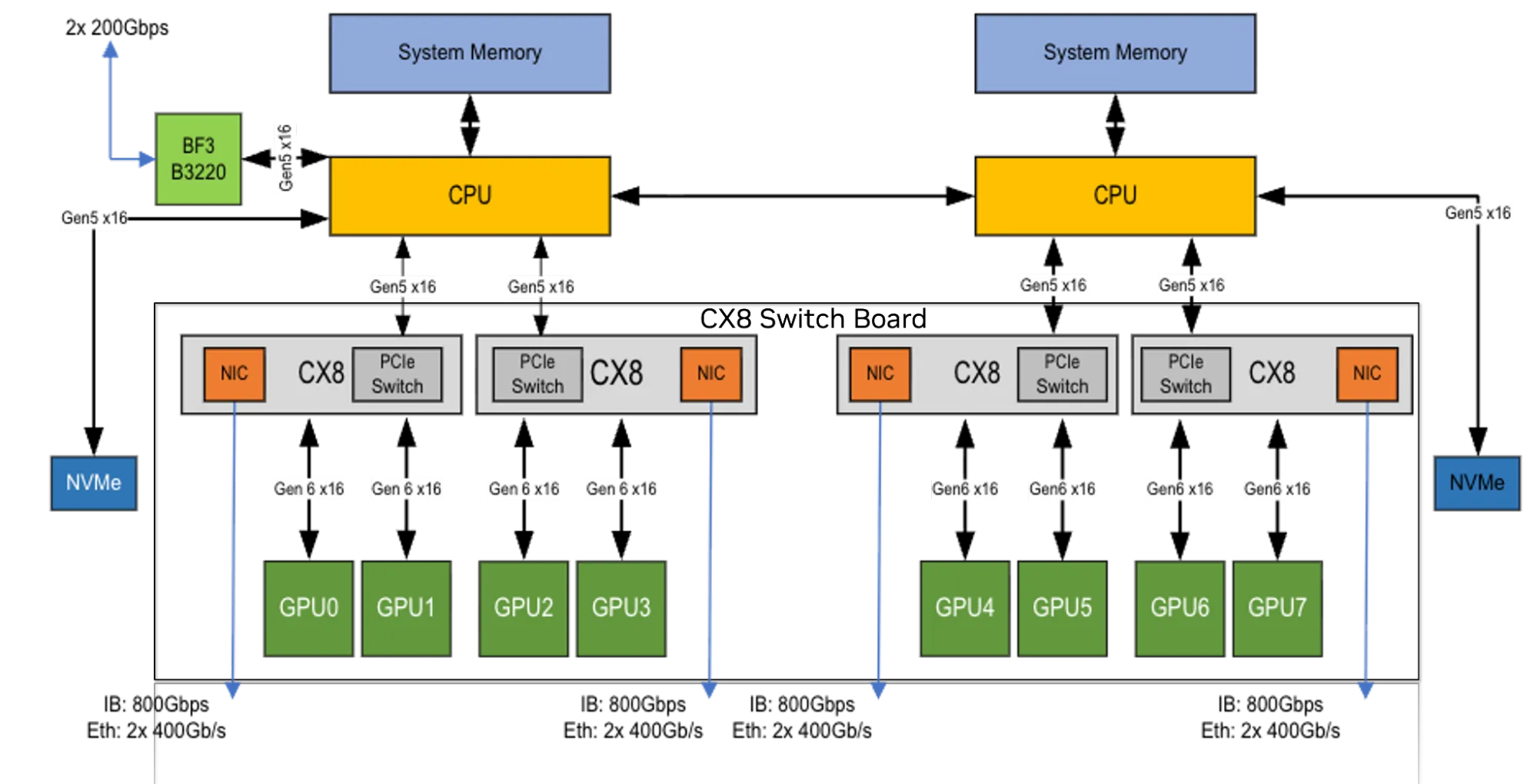

MGX 6U 设计是加速计算平台下一波浪潮的基础,率先应用于全新的液冷 NVIDIA RTX PRO 服务器。该 RTX PRO 服务器配置将搭载 8 个最新液冷 RTX PRO Blackwell 服务器版 GPU,同时配备由 NVIDIA BlueField-3 DPU 以及集成 PCIe Gen 6 交换机的 NVIDIA ConnectX-8 SuperNIC 所支持的先进 AI 网络功能(图 1)。

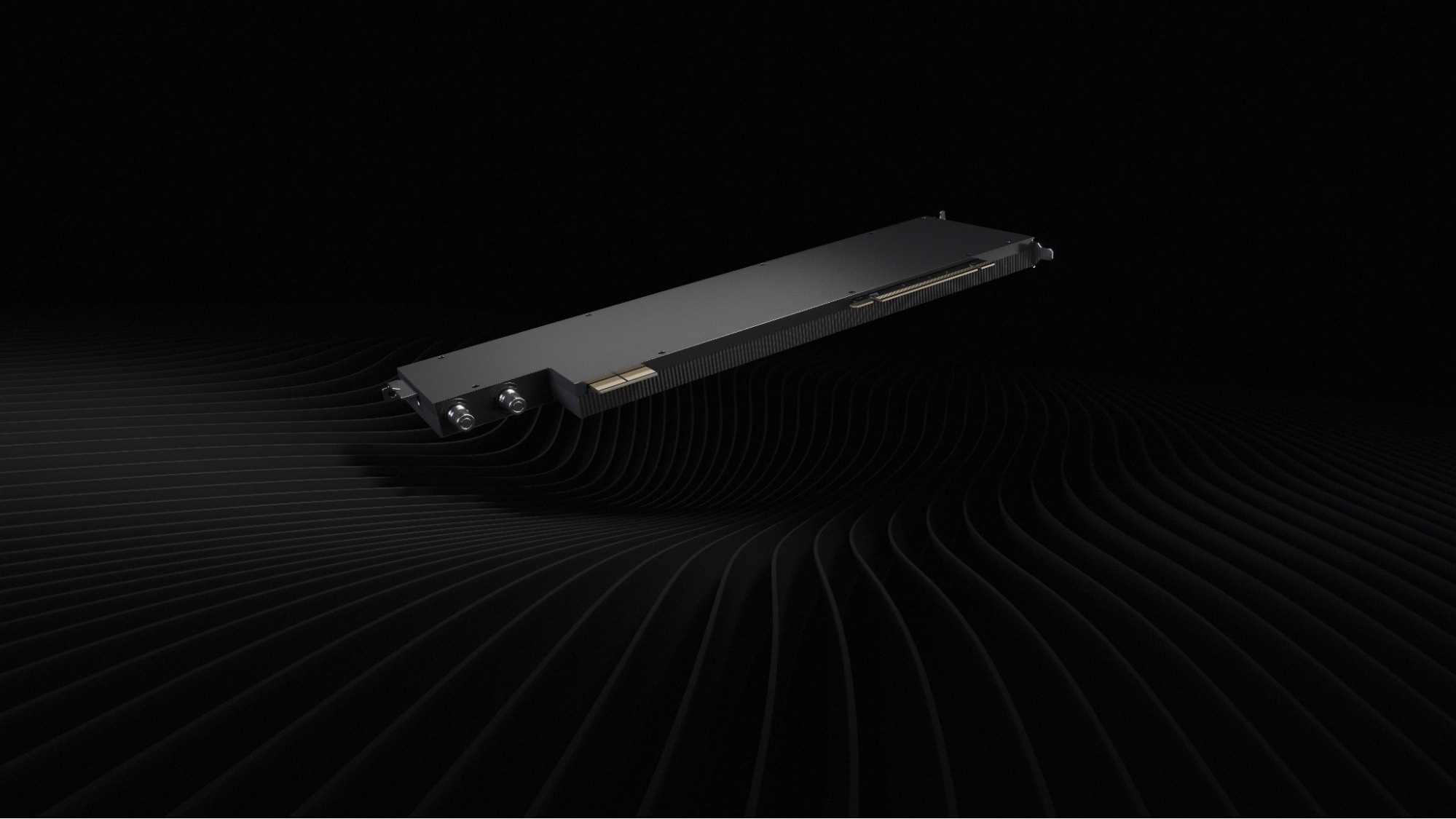

RTX PRO Blackwell 采用紧凑的单插槽液冷设计,可提供卓越性能,为 AI 工厂 提供动力支持,并通过提升热效率加速企业级 AI 工作负载的运行。该平台支持完整的 NVIDIA 企业软件套件,包括 NVIDIA AI Enterprise、NVIDIA Omniverse、NVIDIA vGPU 和 NVIDIA Run:ai,打造统一的数据中心平台,助力构建和部署新一代 AI 应用,涵盖 代理式 AI 和 物理 AI,延伸至科学计算、仿真、图形与视频等广泛领域。

此外,RTX PRO Blackwell 服务器版 GPU 已获得 50 多家领先企业级 ISV 的认证,覆盖工程、科学计算和专业可视化应用,以及广泛使用的编排、管理和 AI 运营平台。

借助 NVIDIA ConnectX 实现高效能 AI 网络

网络性能对大幅提升大规模 AI 工作负载的性能至关重要。MGX 6U 参考设计目前支持 ConnectX-8 AI 网络,并将在 ConnectX-9 推出后提供支持,具备以太网和 InfiniBand 连接选项,可满足不同数据中心和工作负载的需求。

液冷 RTX PRO 服务器基于 MGX 6U 架构,采用简化的系统设计,并搭载集成 PCIe Gen 6 交换机的新一代 ConnectX-8 SuperNIC。

ConnectX-8 专为 AI 工作负载设计,内置 PCIe Gen 6 交换机,每个 RTX PRO 6000 Blackwell GPU 可实现高达 400 Gb/s 的网络带宽(基于 2:1 的 GPU 与网卡比率)。

与配备专用 PCIe 交换机的系统相比,ConnectX-8 不仅能够简化设计、降低服务器复杂性,还可使每个 GPU 的网络带宽有效提升一倍。这有助于消除 I/O 瓶颈,加速 GPU、NIC 与存储之间的数据传输,从而实现高达 2 倍的 NCCL 全方位性能提升,并支持在 AI 工厂中扩展多* GPU、多* 节点的工作负载。

借助 NVIDIA BlueField 实现 AI 运行时的安全防护与基础设施加速

随着加速基础设施的规模和复杂性持续增加,保障系统每一层的安全变得至关重要。MGX 6U 设计采用 NVIDIA BlueField 数据处理器(DPU),将零信任安全与基础设施加速能力直接带入数据中心层面。BlueField 处理器可卸载并加速线速加密、微分段及实时威胁检测等功能,在实施最小权限访问的同时,保护主机计算资源(GPU/CPU),使其更专注于 AI 与各类现代工作负载。

通过在硬件中隔离控制平面与管理平面,BlueField 使组织能够保护 AI 工作流免受新兴威胁,同时加速网络、存储和虚拟化服务。企业还可通过部署来自领先软件提供商的经验证的 BlueField 加速应用程序,进一步扩展这些功能,从而提升基础设施效率并增强网络安全覆盖。该组合有助于确保 RTX PRO 服务器部署实现安全扩展,并在 AI 工厂的每个节点上保持一致的性能与策略执行。

打造面向未来的 AI 工厂

随着 NVIDIA Blackwell 及新一代 GPU 不断突破传统计算界限,NVIDIA MGX 模块化架构可确保 AI 工厂能够随芯片创新持续演进。对于致力于构建新一代加速计算平台的生态系统合作伙伴而言,MGX 不仅能降低工程成本、缩短上市时间,还提供多代兼容性,同时保障企业在大规模部署 AI 工作负载时获得卓越的性能与效率。

全球系统组装商预计将于2026年上半年推出搭载液冷NVIDIA RTX PRO 6000 Blackwell Server Edition GPU的系统,以及基于MGX 6U配置的液冷RTX PRO服务器。