NVIDIA DeepStream SDK

NVIDIA DeepStream 的多平台支持,为开发者提供了一种更快速、更便捷的方式,在不同环境中构建和部署面向生成式 AI 智能体与应用的实时视频流处理流水线。你甚至可以只需轻点一下按钮,就将这些应用部署在本地机房、边缘设备以及云端。

什么是 NVIDIA DeepStream?

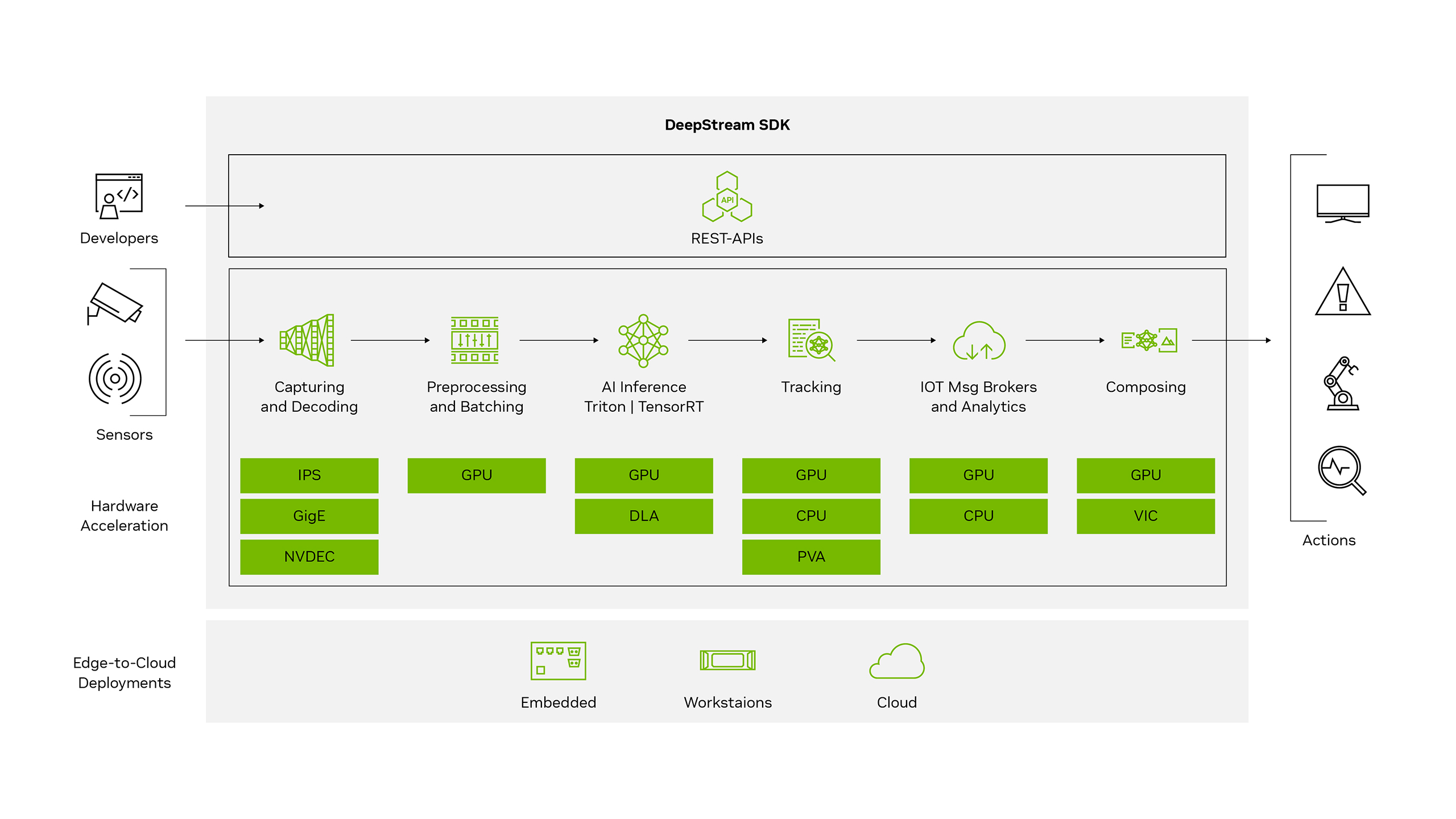

NVIDIA DeepStream SDK 是一款基于 GStreamer 的综合性实时流分析工具包,用于基于 AI 的多传感器处理以及视频、音频和图像理解。它非常适合开发者、软件合作伙伴、初创公司和 OEM,为智慧城市、零售、制造等各行各业构建视觉 AI 智能体、应用和服务。

你现在可以在几分钟内创建并部署流处理流水线,将生成式 AI 与多摄像头跟踪等复杂处理任务集成到一起。为了进一步加速开发,DeepStream 也集成在 NVIDIA Metropolis Blueprint for Video Search and Summarization (VSS) 中。这个用于构建视觉 AI 智能体的示例架构,可以从海量工业视频传感器数据中实时提取有价值的洞察。

优势

从云端到边缘快速部署 AI

DeepStream SDK 提供完整的视频流处理、摄取、多摄像头追踪工作流,且 100% 由 NVIDIA GPU 加速。它非常适合制造、物流、零售等行业的各种用例。

将开发时间缩短到几分钟

DeepStream 编码智能体根据自然语言提示生成完整的视频分析流程,将流程创建时间从数周缩短到数小时。

实时洞察

从图像、视频和激光雷达等传感器数据中实时提取丰富的元数据。

借助 NVIDIA GPU 实现极低的总体拥有成本

通过在 NVIDIA 硬件上使用 DeepStream 部署 AI 模型,提高流密度、更大限度地提高性能并更大限度地降低 TCO。

多种编程选项

使用 C/C++ 和 Python 创建功能强大的视觉 AI 应用。

独特功能

借助编码智能体和 GPU 加速插件加速视觉 AI 开发

DeepStream 开始为基于 AI 的视频、音频和图像分析开发无缝的实时流式传输工作流。它附带 40 多个硬件加速插件以及 30 多个示例应用程序和扩展程序,可优化预处理/ 后处理、推理、多摄像头跟踪、消息代理等。

DeepStream 编码代理根据自然语言提示自动生成完整、符合 FlowAPI 的 DeepStream 工作流,从而将视觉 AI 开发时间从数周缩短到数小时。DeepStream 编码智能体可以使用推理构建器利用大量模板来确保代码质量。

DeepStream Service Maker 通过抽象化 GStreamer 的复杂性来轻松构建面向对象的 C++ 应用程序,从而简化开发流程。使用 Service Maker,只需几行代码即可构建完整的 DeepStream 工作流

DeepStream 库由 NVIDIA® CV-CUDA®、NvImageCodec 和 PyNvVideoCodec 提供支持,可提供低级别 GPU 加速操作,以优化视觉 AI 流程的前后阶段。

在多种摄像头之间启用多摄像头跟踪

多视图 3D 追踪 (MV3DT) 是 DeepStream NvTracker 的扩展,可实现跨摄像头网络的分布式实时 3D 追踪。它与 2D 和 3D 检测器无缝配合,支持广泛的用例。DeepStream 会自动为新对象分配唯一 ID,通过遮挡和切换来保留身份。

为实现精确的多摄像头追踪,DeepStream 包含新的校准工具,可同时将多个摄像头与部署平面图对齐。这可减少人工工作量,并确保结果一致且准确。

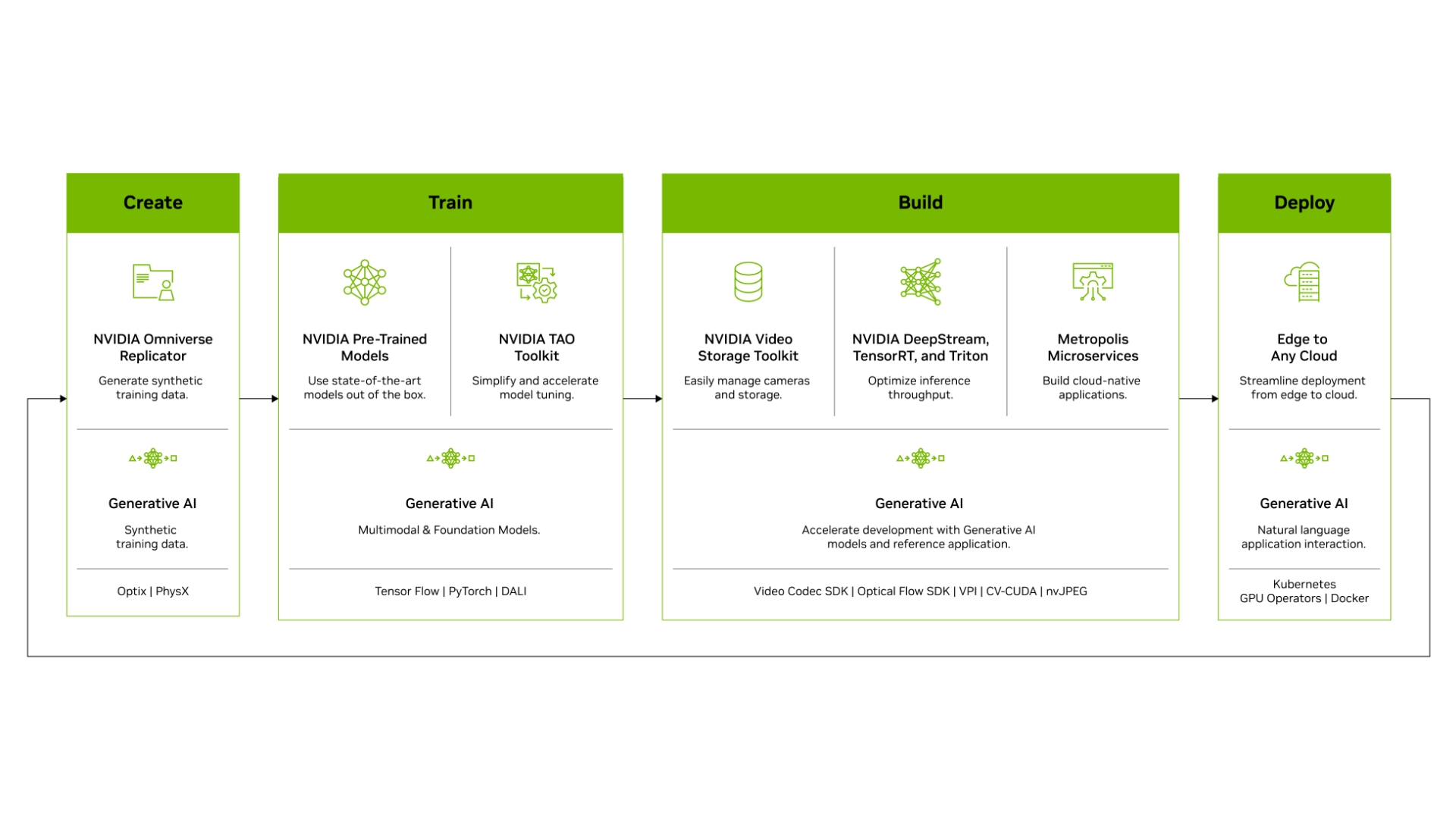

构建端到端 AI 解决方案

借助 NVIDIA Metropolis 构建端到端视觉 AI 应用,加快整体开发工作,并解锁更出色的实时性能。从生产级视觉 AI 模型开始,使用 NVIDIA TAO 工具套件调整和优化这些模型,然后使用 DeepStream 进行部署。使用 Metropolis VSS Blueprint 构建可以同时处理数千个实时视频的视觉 AI 智能体,以推动洞察力和自动化。

获得令人惊叹的灵活性 (从快速原型设计到完整的生产级解决方案) ,并选择推理路径。与 NVIDIA 原生集成 Triton™ 推理服务器您可以在 PyTorch 和 TensorFlow 等原生框架中部署模型以进行推理。对于高吞吐量推理,请使用 NVIDIA TensorRT 实现最佳性能。

享受从边缘到云端的无缝开发

借助 DeepStream 的现成容器,您只需一次构建,即可在云端、搭载 NVIDIA GPU 的工作站或 NVIDIA Jetson™ 设备上的任意位置进行部署。借助 DeepStream Container Builder 和 NGC 容器,您可以轻松创建由 Kubernetes 和 Helm 管理的可扩展、高性能 AI 应用。

借助 DeepStream REST-API,您还可以在运行时管理多个参数,从而简化 SaaS 解决方案的创建。借助标准的 REST-API 接口,您可以构建用于控制和配置的 Web 门户,或将其集成到现有应用中。

为生产做好准备

DeepStream 作为 NVIDIA AI Enterprise 的一部分提供,NVIDIA AI Enterprise 是一个端到端、安全、云原生的 AI 软件平台,经过优化,可加速企业进入 AI 前沿。

NVIDIA AI Enterprise 可提供 NVIDIA AI 开源软件的验证和集成、可缩短生产时间的 AI 解决方案工作流、可在任意位置部署 AI 的认证,以及可降低开源软件潜在风险的企业级支持、安全性和 API 稳定性。

探索构建 DeepStream 工作流的方法

编码智能体

使用自然语言提示,使用 Cloude Code 或 Cursor 生成完整的 DeepStream 工作流,并将编码时间从 8 周缩短到 8 小时。

Python

使用 Gst Python ( GStreamer 框架的 Python 绑定) 构建 DeepStream 工作流。您可在 GitHub 上获取绑定和 Python 示例应用的源代码。

C/C++

使用 C/C++ 创建应用、直接与 GStreamer 和 DeepStream 插件交互,以及使用参考应用和模板。

提高准确性和实时性能

DeepStream 可为各种物体检测、图像处理和实例分割 AI 模型提供出色的吞吐量。下表显示了从数据提取、解码、图像处理到推理的端到端应用程序性能。它需要多个 1080p/ 30fps 的流作为输入。请注意,在 Jetson 设备的 DLA 上运行可以释放 GPU 来处理其他任务。对于性能最佳实践,观看此视频教程。

| Foundation Model | Tracker | Precision | Jetson Thor | DGX Spark | L40S | RTX PRO 4500 | B200 | RTX PRO™ WS | RTX PRO SE |

|---|---|---|---|---|---|---|---|---|---|

| MaskGroundingDINO V2 | No Tracker | FP16 | 23 | 21 | 102 | 63 | 216 | 102 | 101 |

| C-RADIO-Base | No Tracker | FP16 | 1258 | 969 | 2989 | 2050 | 8204 | 4131 | 3754 |

| C-RADIO-Large | No Tracker | FP16 | 547 | 337 | 1097 | 647 | 3831 | 1497 | 1303 |

| NV-DinoV2-Large | No Tracker | FP16 | 431 | 239 | 873 | 533 | 3568 | 1292 | 1173 |

| RT-DETR | No Tracker | FP16 | 195 | 160 | 649 | 345 | 1280 | 659 | 978 |

| RT-DETR | NvDCF | FP16 | 171 | 153 | 615 | 316 | 1249 | 640 | 955 |

| RT-DETR | MV3DT | FP16 | 90 | 100 | 237 | 257 | 900 | 645 | 537 |

| TrafficCamNet Transformer Lite | NvDCF | FP16 | 144 | 139 | 665 | 369 | 1088 | 650 | 918 |

| Peoplenet2.6.3 | MV3DT | FP16 | 363 | 350 | 724 | 595 | 2016 | 1225 | 763 |

| Peoplenet Transformer | MV3DT | FP16 | 24 | 13 | 137 | 78 | 230 | 208 | 175 |

| Grounding-DINO | No Tracker | FP16 | 23 | 21 | 101 | 63 | 218 | 103 | 102 |

| SegFormer + C-RADIO-Base | No Tracker | FP16 | 253 | 201 | 1008 | 435 | 1488 | 1236 | 1061 |

| Mask2Former + SWIN | No Tracker | FP16 | 26 | 29 | 76 | 70 | 144 | 75 | 99 |

如需详细了解使用 DeepStream 的性能,请查看文档。

阅读客户案例

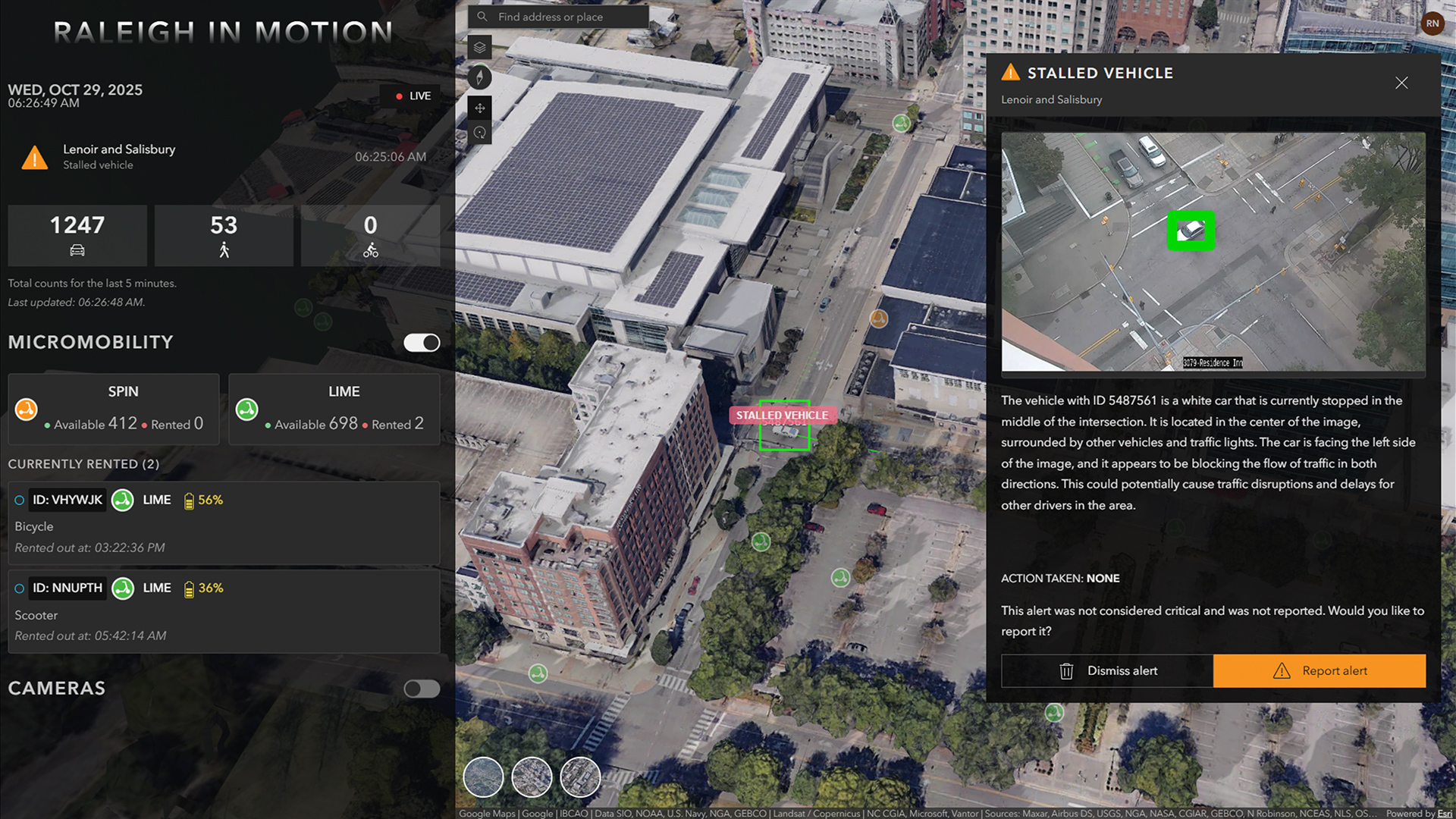

提升城市安全与出行效率

罗利市使用 NVIDIA DeepStream 和 VSS Blueprint 构建 AI 智能体,并以 4 倍的速度提供实时见解,这可能每年为通勤者节省约 970 万美元的时间和燃料成本。

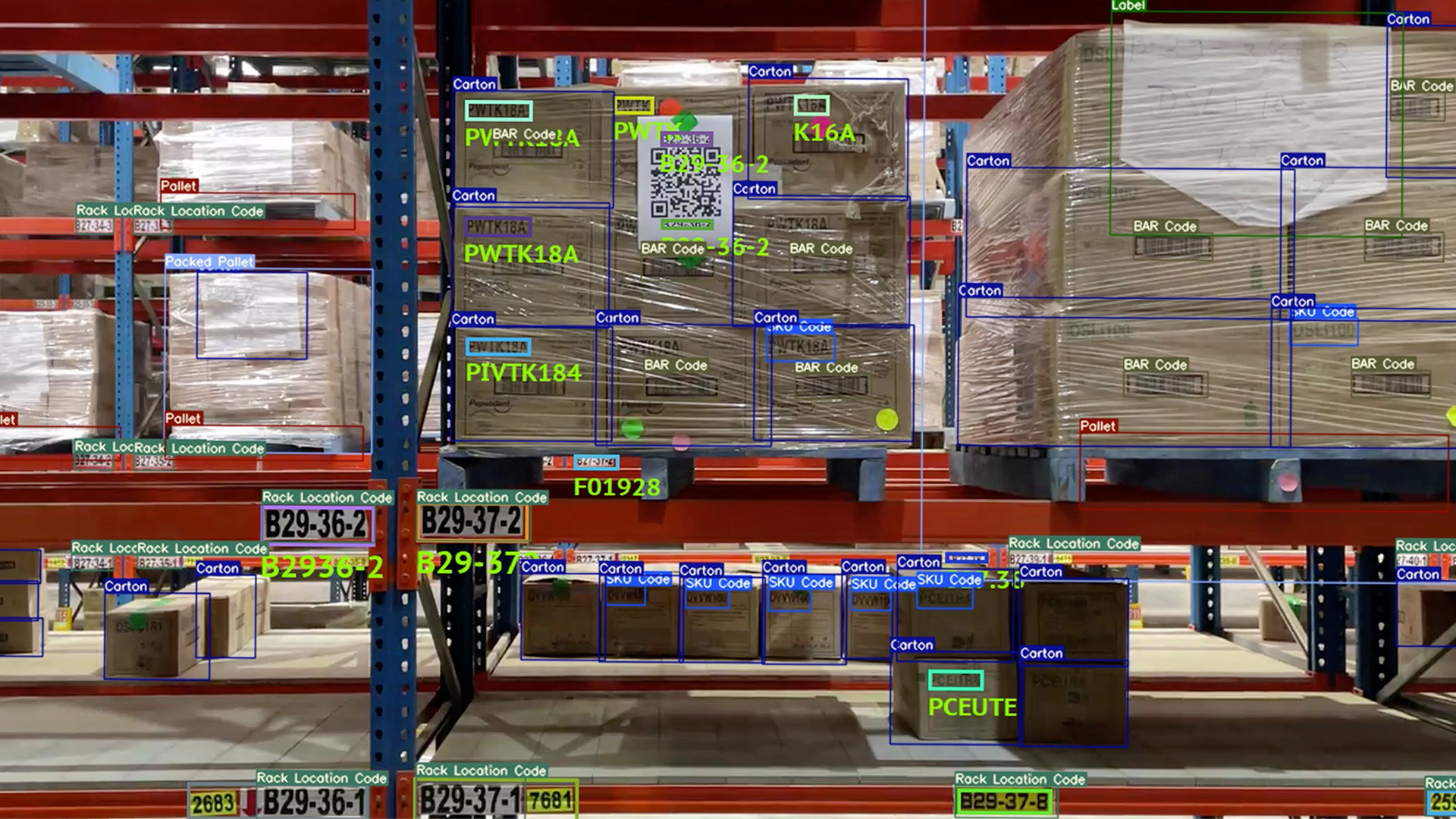

提升配送中心的运营

KoiReader 使用 NVIDIA 开发者工具 (包括 DeepStream SDK) 开发了 AI 赋能的机器视觉解决方案,帮助百事公司在动态分发环境中实现精度和效率。

优化班加罗尔机场的运营

Industry.AI 使用 NVIDIA Metropolis 堆栈 (包括 DeepStream) 来提高机场的安全性和效率。借助视觉 AI,它能够追踪被遗弃的行李、标记长乘客队列,并提醒安全团队潜在的问题。

一般常见问题解答

DeepStream 是一款闭源 SDK。请注意,所有参考应用的源代码和多个插件均可用。DeepStream 推理构建器将开源并可通过 GitHub 获取。

DeepStream SDK 可用于构建 AI 赋能的端到端应用,以分析视频和传感器数据。一些热门用例包括零售分析、停车管理、物流管理、光学检测、机器人和体育分析。

请参阅平台和操作系统兼容性表。

是的,现在通过集成 Triton 推理服务器™,这一切得以实现。此外,从 DeepStream 6.1.1 开始,应用可以使用 gPRC 与 Triton 推理服务器的独立/远程实例进行通信。

DeepStream 支持多种开箱即用的热门模型。例如,DeepStream 支持所有 NVIDIA TAO 模型,并附带运行 YOLO 模型的示例。

是,DeepStream 8.0 或更高版本支持 NVIDIA Blackwell 架构。

DeepStream 不再直接支持自动语音识别 (ASR) 和文本转语音 (TTS) 等音频处理功能。需要语音识别或语音合成的客户应使用 NVIDIA Riva 语音 AI SDK,该 SDK 提供针对 NVIDIA GPU 优化的生产级 ASR 和 TTS 服务。

使用 DeepStream SDK 构建高性能视觉 AI 应用和服务。