AI 正在从实验转向生产。但是,企业需要的大多数数据都存在于公有云之外。这包括敏感信息,如患者记录、市场研究和包含企业知识的传统系统。此外,还存在将隐私数据用于 AI 模型的风险,并且采用速度通常会因隐私和信任问题而减慢或受阻。

构建新一代 AI 工厂的企业 (专门用于大规模制造智能的高性能基础设施) 必须建立在零信任基础之上。这种安全架构通过使用硬件强化的可信执行环境 (TEE) 和加密认证,消除了对底层主机基础设施的隐式信任。本文将介绍将零信任基础集成到 AI 工厂所需的全栈架构。

本地部署要求通常会限制企业构建自己的模型或使用开源模型来处理代理式 AI 工作负载。为了实现 AI 的承诺,组织必须在其运营的基础设施上部署各种模型 (包括专有模型) ,而不会向管理员、服务器虚拟化平台或主机操作系统公开敏感数据或模型权重。另一方面,模型提供商需要加密保证,即使在其受控环境之外部署,其 IP 也无法提取。

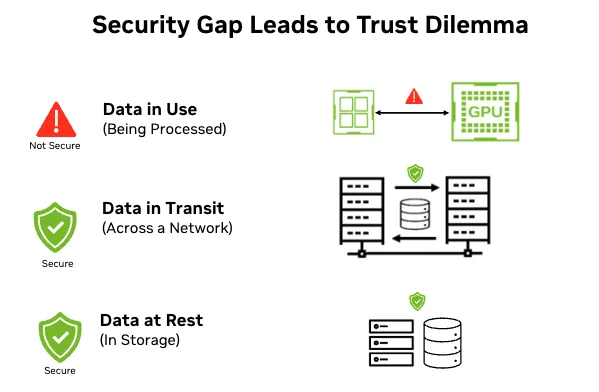

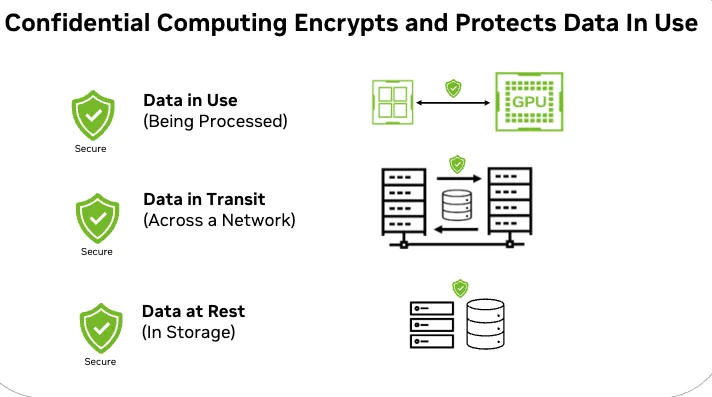

机密计算通过解决信任困境来提供这种保证,这需要每个角色都默认信任,而无需实际验证信任。

AI 工厂信任困境

在共享基础设施上部署专有的前沿模型,在 AI 工厂的关键利益相关者之间造成了三重信任困境:

- 模型所有者与基础架构提供商:模型所有者需要保护其专有 IP (模型权重、算法逻辑) ,并且无法相信主机操作系统、hypervisor 或 root 管理员不会检查、窃取或提取其模型。

- 基础架构提供商与模型所有者/ 租户:基础架构提供商 (运行硬件和 Kubernetes 集群的提供商) 无法相信模型所有者或租户的工作负载是良性的。它可能包含恶意代码、尝试权限升级或破坏主机安全边界。

- 租户 (数据所有者) 与模型所有者和基础设施提供商:数据所有者必须确保其受监管的敏感数据保持机密性。他们无法相信基础设施提供商在执行期间不会查看数据,或者模型提供商在推理期间不会滥用或泄露数据。

这种循环缺乏信任的根源在于,在传统计算环境中,数据是不加密的。这使得敏感数据和专有模型以明文形式公开给内存和系统管理员。机密计算通过确保数据和模型在整个执行生命周期中始终受到加密保护来解决这一问题,即整个执行生命周期中。

利用机密容器实现安全的 AI 工厂

机密计算提供了硬件基础。机密容器 (CoCo) 可将其用于 Kubernetes。

借助 CoCo,Kubernetes Pod 能够在硬件支持的 TEE 内运行,而无需重写应用程序。每个 POD 不是共享主机内核,而是使用 Kata 容器透明地包装在一个硬件隔离的轻量级虚拟机 (VM) 中,从而在保持强隔离边界的同时保留云原生工作流。

对于模型提供商而言,最大的风险是基础架构所有者窃取专有模型权重。CoCo 通过从信任方程中删除主机操作系统和服务器虚拟化平台来解决这一问题。部署模型时,模型将保持加密状态,直到硬件通过称为远程认证的过程,以数学方式证明该安全区的安全性。只有这样,密钥代理服务 (KBS) 才能将解密密钥释放到受保护的内存中,确保模型永远不会以明文形式暴露给主机。

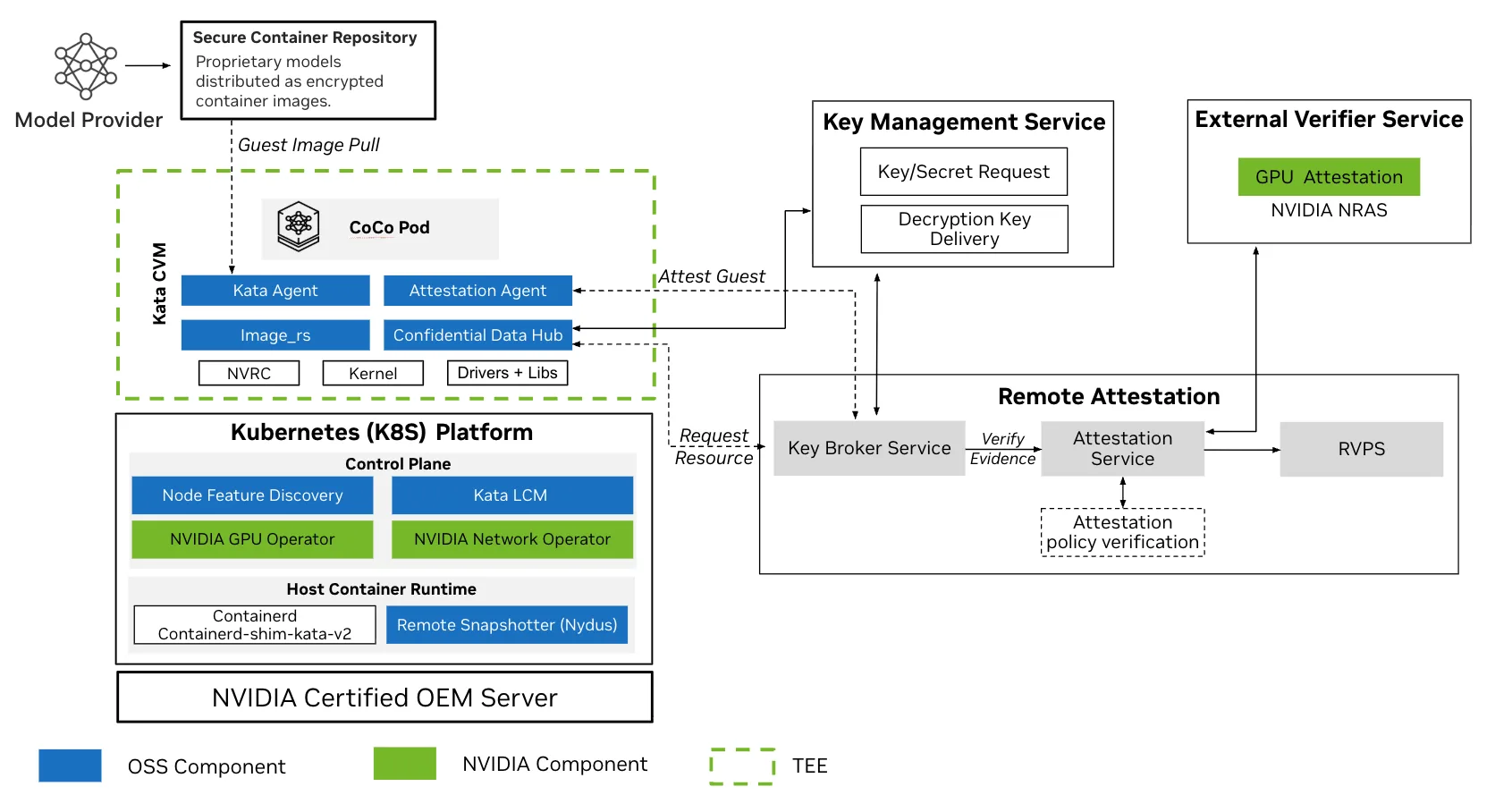

适用于零信任 AI 工厂的开放式参考架构

NVIDIA 为 CoCo 软件堆栈提供了一个参考架构。这是一个标准化的蓝图,使用开源项目(例如 Kata Containers)中的组件与机密容器社区合作开发,用于在裸机基础设施上构建零信任 AI 工厂。它定义了如何结合硬件和软件来安全部署前沿模型,而不会将其数据或权重暴露给主机环境。

该架构的核心支柱包括:

- 硬件信任根: 将 CPU TEE 与 NVIDIA 机密 GPU (如 NVIDIA Hopper 或 NVIDIA Blackwell) 搭配使用,用于硬件加速、内存加密的 AI 工作负载。

- Kata 容器运行时: 将标准 Kubernetes Pod 包装在轻量级、硬件隔离的实用 VM (UVM) 中,而不是共享主机内核。

- 强化微任务环境: 使用无发行版的最小客户机操作系统,并配备棱角分明的根文件系统和 NVIDIA 运行时容器 (NVRC),以实现安全的初始化系统,从而减少 VM 内部的攻击面。

- 认证服务: 通过加密证据验证硬件,然后向客户机释放敏感的模型解密密钥或机密。这需要包含 KBS 的远程认证框架。

- 机密工作负载生命周期:促进将加密和签名图像 (容器、模型、构件) 直接安全提取到加密的 TEE 内存中,防止在静态或传输过程中暴露。并启用细粒度策略,以保护客户机层和非受信任基础设施层之间的接口。

- 原生 Kubernetes 和 GPU Operator 集成: 使用标准 Kubernetes 基元和 NVIDIA GPU Operator 管理此堆栈,在不重写部署清单或 AI 应用的情况下实现“提升和转移”部署。

威胁模型和信任边界

CoCo 在严格的威胁模式下运行。基础架构层(包括主机操作系统、服务器虚拟化平台和云提供商)被视为不可信任。

CoCo 不再依靠基础设施管理员来实施安全控制,而是将信任边界转移到硬件支持的 TEE。AI 工作负载在加密的虚拟化环境中运行,主机无法检查内存内容,只有在执行环境证明其完整性后才会释放机密。了解哪些是受保护的,哪些是不受保护的,这一点非常重要。

CoCo 保护的内容

CoCo 为执行期间的机密性和完整性提供了强有力的保证,包括以下内容:

- 数据和模型保护: 显存加密可防止主机在工作负载运行时访问敏感数据、模型权重或推理有效载荷。

- 执行完整性: 在释放机密或模型解密密钥之前,远程认证会根据预期的软件测量结果,验证工作负载是否在可信环境中运行。

- 安全的镜像和存储处理:在加密客户机环境中拉取和解压缩容器镜像,确保主机基础设施无法检查或篡改应用程序代码或模型伪影。

- 防止主机级访问: 内存检查、磁盘抓取或管理调试工具等主机特权操作无法公开工作负载内容。

CoCo 无法保护的内容

某些风险仍在架构范围之外,例如:

- 应用程序漏洞:机密执行可确保经过验证的软件在“Enclave” (安全区) 内运行,但不会阻止应用程序中的漏洞。

- 可用性攻击:该平台可确保机密性和完整性,但基础架构运营商可以通过拒绝调度或终止工作负载来中断工作负载。

- 非硬件隔离区:模型依赖于硬件支持的 TEE。它不适用于基于软件的隔离机制。

- 网络和存储安全:CoCo 信任边界不涵盖应用之间的网络连接。应用必须建立自己的安全通道,以防止传输中的数据暴露,并使用适当的机密存储机制。

借助综合认证,安全部署模型

此端到端工作流基于远程认证程序 (RATS) 架构,可实现安全密钥释放,以在 TEE 中部署加密模型:

- Initiation (初始化): 当工作负载需要密钥 (如模型解密密钥) 时,Kata VM 内的 Attestation Agent (AA) 会启动与外部 KBS 的身份验证握手。

- 证据收集: 机管局从 TEE 处收集加密硬件证据 (例如 CPU 引号或 NVIDIA GPU 报告) ,并将其发送至 KBS。

- 委托验证: KBS 将此证据转发给认证服务 (AS) 。

- 验证: AS 根据参考值提供商服务 (RVPS) 提供的安全策略和“已知良好”衡量标准来评估证据。对于专用硬件,AS 充当代理,并将验证委托给外部供应商服务,例如 NVIDIA 远程认证服务 (NRAS) 或 Intel Trust Authority。

- Token 发布: 如果环境在数学上证明其安全且不受篡改,KBS 会将证明结果 token 和会话 ID 返回给客户的 AA。

- 安全密钥发布: 机管局使用此 token 请求特定密钥。KBS 从其后端 (如密钥管理服务) 检索机密,并将其安全地传递给客户机 VM 内的机密数据中心 (CDH) 。

- 执行: CDH 将明文密钥直接公开给您的 AI 容器,允许模型只能在受保护内存中解密。

生态系统合作伙伴

NVIDIA 生态系统合作伙伴正在实现零信任 AI 工厂,包括 Red Hat、Intel、Anjuna Security、Fortanix、Edgeless Systems、OPAQUE Systems、Equity Labs、Sovereign AI、Converge.ai、戴尔、HPE、联想、思科和 Supermicro,以推进生产就绪型机密计算,并帮助企业释放 AI 的价值。

开始使用

如需了解详情,请参阅 NVIDIA 机密计算参考架构。