Kubernetes

2026年 4月 9日

使用 Slurm 在 Kubernetes 上运行大规模 GPU 工作负载

Slurm 是适用于 Linux 的开源集群管理和作业调度系统。它可以管理超过 65% 的 TOP500 系统 的作业调度。

3 MIN READ

2026年 3月 23日

在 Kubernetes 上部署解 LLM 推理工作负载

随着大语言模型 (LLM) 推理工作负载的复杂性不断增加,单个单一的服务进程开始达到其极限。预填充和解码阶段具有截然不同的计算配置文件,

4 MIN READ

2026年 3月 16日

NVIDIA Dynamo 1.0 如何助力量产级多节点推理

推理模型的规模正在迅速增长,并且越来越多地集成到与其他模型和外部工具交互的代理式 AI 工作流中。

4 MIN READ

2026年 1月 28日

基于时间的公平共享实现 Kubernetes 集群 GPU 分配均衡

NVIDIA Run:ai v2.24 引入了基于时间的公平分享,这是一种全新的调度模式,可为 Kubernetes 集群实现公平分享调度,

2 MIN READ

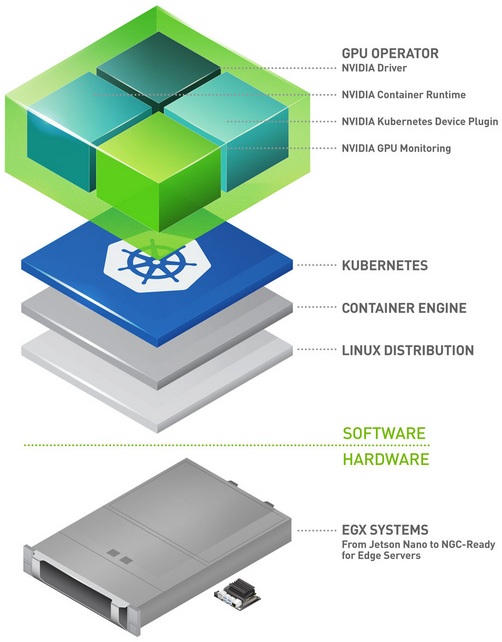

2020年 8月 18日

使用 NVIDIA EGX 在 NVIDIA Jetson Xavier NX 微型服务器上部署 AI 应用程序

现代对敏捷能力和零停机时间持续创新的期望要求改变嵌入式和边缘设备软件的开发和部署方式。在边缘采用诸如微服务、

6 MIN READ

2019年 10月 21日

简化 Kubernetes 中的 GPU 管理

在过去的几年里, NVIDIA 以各种方式利用 GPU 容器来测试、开发和大规模运行生产中的 AI 工作负载。

4 MIN READ