LLMs

2026年 5月 7日

借助 Slurm 块调度在 NVIDIA GB200 NVL72 上实现峰值系统和工作负载效率

NVIDIA GB200 NVL72 通过在整个机架范围内扩展 NVIDIA NVLink 一致性,开创了一种全新的 GPU 集群构建方式。

3 MIN READ

2026年 4月 28日

NVIDIA Nemotron 3 Nano Omni 在单个高效开放模型中助力多模态智能体推理

代理式系统通常会在单个感知到动作循环中跨屏幕、文档、音频、视频和文本进行推理。但是,它们仍然依赖于碎片化的模型链,即视觉、

3 MIN READ

2026年 4月 28日

全天候模拟循环:代理式 AI 如何保持地下工程的移动

地下行业正处于数字化发展的关键时刻。几十年来,挖掘油藏潜力一直依赖于执行必要且耗时的手动工作流程的专家。 随着数据复杂性的增加,

2 MIN READ

2026年 4月 20日

使用端到端 FP8 精度运行高吞吐量强化学习训练

随着 LLM 从简单的文本生成过渡到复杂的推理,强化学习 (RL) 发挥着核心作用。群相对策略优化 (GRPO) 等算法为这种转变提供动力,

3 MIN READ

2026年 4月 17日

使用 OpenClaw 和 NVIDIA NemoClaw 构建更安全、始终运行的本地 AI 智能体

智能体正在从问答系统发展为长期运行的自主助手,可读取文件、调用 API 并驱动多步骤工作流。但是,

3 MIN READ

2026年 4月 2日

借助 Gemma 4,让 AI 更贴近边缘和设备端

随着最新 Gemma 4 多模态和多语言模型的推出,Gemmaverse 得以扩展,

2 MIN READ

2026年 3月 24日

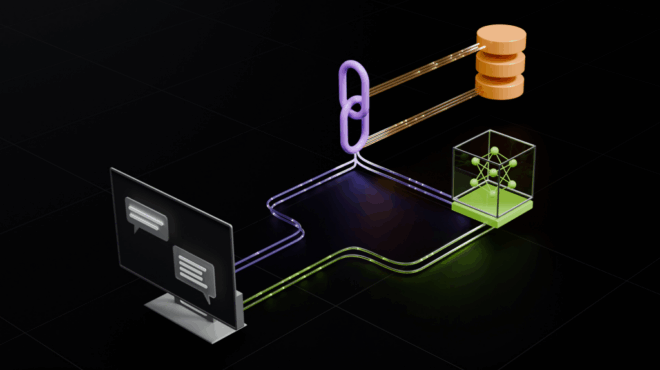

构建用于推理、多模态 RAG、语音和安全的 NVIDIA Nemotron 3 智能体

代理式 AI 是一个专业模型协同工作的生态系统,可处理规划、推理、检索和安全护栏。随着这些系统的扩展,开发者需要能够理解现实世界多模态数据、

3 MIN READ

2026年 3月 23日

为机密 AI 工厂构建零信任架构

AI 正在从实验转向生产。但是,企业需要的大多数数据都存在于公有云之外。这包括敏感信息,如患者记录、市场研究和包含企业知识的传统系统。此外,

2 MIN READ

2026年 3月 18日

如何使用 NVIDIA AI-Q 和 LangChain 构建用于企业搜索的深度智能体

虽然消费者 AI 提供了强大的功能,但工作场所工具通常会因数据不连贯和上下文有限而受到影响。 基于 LangChain 构建,

3 MIN READ

2026年 3月 16日

使用 NVIDIA OpenShell 更安全地运行自主、自演化代理

AI 已经从跟随你指令的助手发展为独立行动的智能体。这些被称为“爪”的智能体可以达成目标,找出实现目标的方法,并无限执行任务,

1 MIN READ

2026年 3月 11日

隆重推出 Nemotron 3 Super:用于代理式推理的开放式混合式 Mamba-Transformer MoE

代理式 AI 系统需要具有专业深度的模型来自主解决密集的技术问题。它们必须在推理、编码和长上下文分析方面表现出色,同时保持足够的效率,

3 MIN READ

2026年 3月 9日

从解服务中移除猜测

部署和优化大语言模型 (LLM) 以实现高性能、经济高效的服务可能是一项艰巨的工程难题。任何给定工作负载 (例如硬件、并行和预填充/

3 MIN READ

2026年 2月 27日

借助 NVIDIA Run:ai 与 NVIDIA NIM 充分释放 GPU 性能潜力

部署 LLM 的组织面临着推理工作负载的挑战,这些工作负载具有差异化的资源需求。小型嵌入模型可能仅需几 GB 的 GPU 显存,

4 MIN READ

2026年 2月 25日

借助 NVIDIA Blackwell Ultra 提升 Softmax 的效率

LLM 上下文长度呈爆炸式增长,架构正朝着更复杂的注意力机制发展,例如多头潜在注意力(MLA)和分组查询注意力(GQA)。因此,

2 MIN READ

2026年 2月 18日

在 NVIDIA Run:ai 中利用 GPU 解锁大规模 Token 吞吐能力

随着 AI 工作负载的扩展,实现高吞吐量、高效资源利用和可预测的延迟变得愈发关键。 NVIDIA Run:ai 通过智能调度和动态 GPU…

4 MIN READ

2026年 2月 17日

构建 AI 就绪型知识系统:掌握 5 种核心多模态 RAG 功能

企业数据本身具有高度复杂性:现实世界中的文档是多模态的,包含文本、表格、图表与图形、图像、扫描页面、表单以及嵌入式元数据。

3 MIN READ