AI 已经从跟随你指令的助手发展为独立行动的智能体。这些被称为“爪”的智能体可以达成目标,找出实现目标的方法,并无限执行任务,同时让您摆脱束缚。Claw 能力越强,就越难以信任。他们自主发展的能力改变了运营环境的方方面面。

到目前为止,更安全地运行 Claw 的基础设施还不存在。

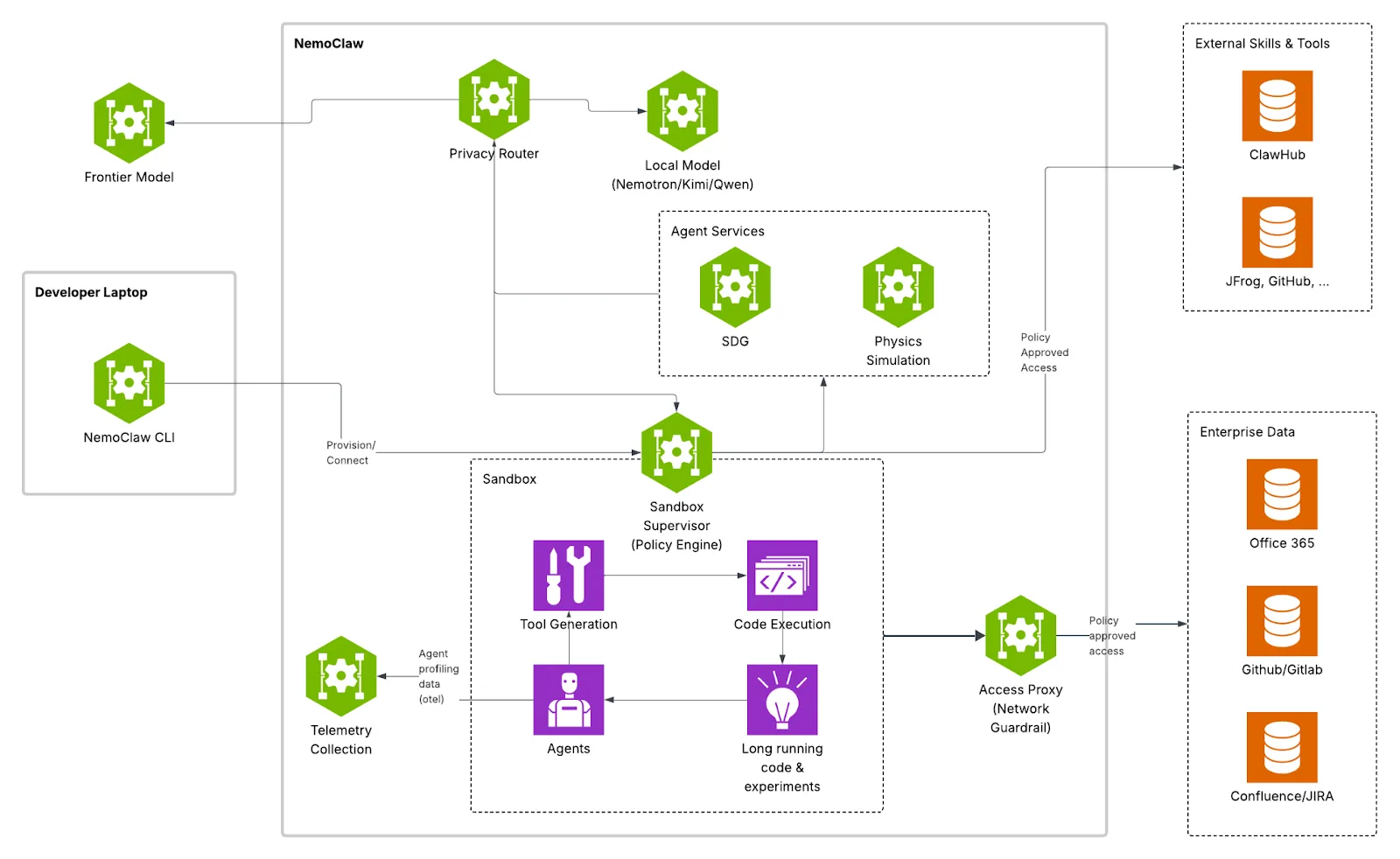

NVIDIA 今天宣布 NemoClaw,这是一个开源堆栈,只需一条命令即可简化始终开启的 OpenClaw 助手的运行。它包含基于策略的隐私和安全护栏,让您可以控制智能体的行为和数据处理。这使得自主进化的 Claw 能够在云端、本地、NVIDIA RTX PC 和 NVIDIA DGX Spark 上更安全地运行。

NVIDIA NemoClaw 使用开源模型——如 NVIDIA Nemotron——以及 NVIDIA OpenShell 运行时,这是 NVIDIA Agent Toolkit 的一部分。通过将强大的开源模型与内置安全措施相结合,NemoClaw 可简化 AI 智能体的部署并确保其安全。

同时,NVIDIA Agent Toolkit 可提供完整的部署堆栈 (模型、工具、评估和运行时) ,用于构建、测试和优化长时间运行的智能体,这些智能体可以规划任务,跨应用和企业数据工作,并作为可靠的生产就绪型服务运行。

OpenShell 基于 Apache 2.0,介于智能体和基础架构之间。它控制着智能体的执行方式、智能体可以看到和执行的操作,以及推理的去向。OpenShell 使 Claw 能够在独立的沙盒中运行,让您能够精细控制隐私和安全,同时从智能体的工作效率中获益。

运行一条命令: openshell sandbox create --remote spark --from openclaw,无需更改代码。然后,任何 Claw 或编码代理 (如 OpenClaw、Anthropic 的克劳德代码或 OpenAI 的 Codex) 都可以在 OpenShell 中未经修改地运行。

本博客将讨论 AI 智能体的演变,并详细介绍 OpenShell 的工作原理。

Claw 如何带来风险

Claw 能够记住不同会话的上下文,生成子代理以独立行动,编写自己的代码以学习新技能,使用工具,并在关闭笔记本电脑后继续执行任务。个人开发者首次可以启动一个代理来完成团队工作,持续运行并处理需要协调、流程和数周时间的复杂性。

像 OpenClaw 这样的长期运行的智能体不仅提高了工作效率,还带来了安全风险。当今的智能体运行时类似于网络的早期。它们功能强大,但缺少核心安全基元:沙盒、权限和隔离。

要让长期运行的自进化智能体真正发挥作用,您需要同时具备三个要素:安全性、能力和自主性。使用现有方法,一次只能可靠地获得两个。如果智能体安全且自主,但无法访问所需的工具和数据,则无法完成工作。如果您有能力且安全,但却不断获得批准,那么您就是在看护它。如果具备完全访问权限的能力和自主性,您就拥有了长期运行的流程监管机制,护栏就位于它们应该守护的同一流程中。

最后一个是最关键的故障模式。无状态聊天机器人没有有意义的攻击面。拥有持久 shell 访问权限、实时凭据、重写自身工具的能力,并针对内部 API 运行六小时累积上下文的智能体,是一种完全不同的威胁模型。每次提示注入都可能导致凭据泄露。Claw 安装的每个第三方技能都是未经审核、具有文件系统访问权限的二进制文件。它衍生的每个子代理都可能继承其本不应拥有的权限。

智能体已准备就绪。您需要真正信任他们的环境一直缺失。

NVIDIA 如何构建 OpenShell

OpenShell 背后的核心架构决策是进程外策略实施。它不是依赖行为提示,而是对智能体运行的环境施加约束,这意味着智能体即使受到入侵,也无法覆盖这些提示。这是应用于智能体的浏览器选项卡模型:会话是隔离的,在任何操作执行之前,权限由运行时进行验证。

Claude Code 和 Cursor 等工具附带有宝贵的内部护栏和系统提示,但这些保护功能存在于智能体内部。OpenShell 将这些工具封装在一起,将终极控制点完全移到智能体无法触及的范围之外。

运行时依赖于许多部分,但以下是 NVIDIA 目前提供的一些内容:

- 沙盒专为长时间运行、自进化的智能体而设计。它不是通用容器隔离。它负责技能开发和验证、可编程系统和网络隔离,以及代理可以在不接触主机的情况下破坏的隔离执行环境。当开发者获得批准时,策略更新会在沙盒范围内实时进行,并对每个允许和拒绝决策进行完整的审计跟踪。

- 策略引擎 在文件系统、网络和进程层对智能体环境施加限制。在安装软件包、在运行时学习技能和生成范围内的子智能体时,自我进化的智能体需要精细的监督才能信任它们。通过在二进制、目标、方法和路径级别评估每个动作,该引擎可确保智能体可以安装经过验证的技能,但无法执行未经评审的二进制文件。智能体将获得在您定义的边界内发展所需的自主性。如果智能体遇到限制,它可以对障碍进行推理,并提出策略更新,最终获得批准。

- 隐私路由器仅在策略允许的情况下,使用本地开放模型将敏感的上下文保留在设备上,并路由到克劳德和 GPT 等前沿模型。路由器根据您的成本和隐私政策而不是代理的政策做出决策。OpenShell 的设计与模型无关,并提供了可以管理所有智能体及其工具的环境。

OpenShell 如何实现新一代 Claw

OpenShell 旨在从 NVIDIA DGX Spark 或 NVIDIA 堆栈上的单个开发者扩展到企业级部署,并在各个级别使用相同的基元。其中包括默认拒绝、实时策略更新和完整的审计跟踪,无论您是一名开发者还是在运行企业 GPU 集群。

Claw 的采用和使用正在加速,未来 6 到 12 个月内做出的基础架构决策将在很长一段时间内塑造企业智能体部署的格局。

随着时间的推移,使用 OpenShell 构建的智能体可以使用热门的编码智能体 (如 Claude Code、Codex、Cursor 和 OpenCode) 不断培养新技能,您可以通过沙盒界面添加工具、模型和行为,同时将每个新功能置于相同的策略和隐私控制之下。

立即开始使用 OpenShell,访问 NVIDIA 的 GitHub 仓库,并在您的 NVIDIA DGX Spark、NVIDIA DGX 工作站或配备 NVIDIA RTX GPU 的专用 PC 上运行它。